多模态触觉与视觉融合感知,实现灵巧的家政服务机器人

2024-08-18 08:32:28 来源:麦姆斯咨询 评论:0 点击:

在机器人研究领域,将类人感知能力赋予机器人一直是研究者们努力追求的目标,旨在使机器人能够更深入地理解和感知周围世界。近年来,触觉感知以及触觉与视觉融合感知技术为这一领域带来了突破性的进展。这些创新的技术有望彻底改变机器人感知和交互的方式。然而,目前的感知技术仍无法完全满足机器人在家庭任务和环境中的需求,尤其在多模态信息整合与融合、快速响应能力和高灵敏度感知等方面仍面临巨大挑战。

据麦姆斯咨询报道,针对该领域的挑战,清华大学朱荣教授团队近期提出一种柔性触觉传感器解决方案,该触觉传感器能够利用薄膜热敏电阻实现对压力、温度、物质热性能、纹理和滑移的多模态感知。基于该触觉传感器,研究人员进一步提出一种机器人触觉-视觉融合架构,该架构巧妙地将多模态感知信息从底层传感器无缝整合到顶层决策系统,实现了全方位的信息融合。利用触觉-视觉融合架构和相应的抓取/识别策略,机器人能够灵巧准确地抓取各种日常物品,并应对日常生活中各种具有挑战性的复杂任务,充分展示了该技术在智能家政领域的巨大应用潜力。相关研究成果以“Multimodal tactile sensing fused with vision for dexterous robotic housekeeping”为题发表在Nature Communications期刊上。

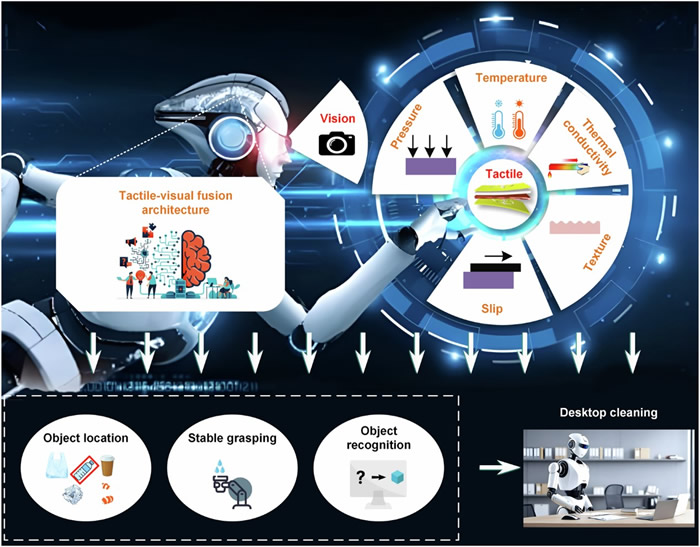

图1 可实现复杂家政任务的触觉-视觉融合感知机器人

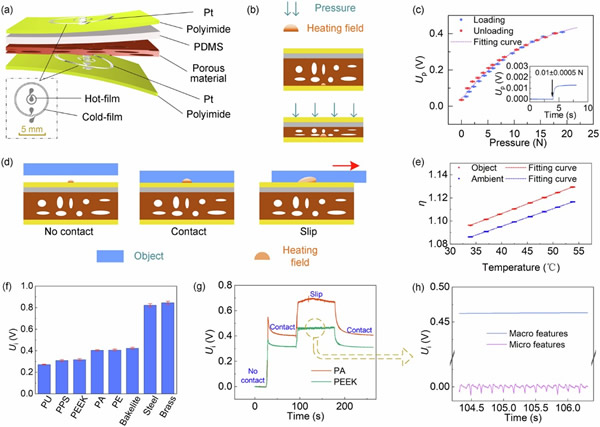

这项研究提出的柔性触觉传感器采用统一的热感原理来感知多模态属性,包括压力、温度、热导率、物体纹理以及滑移检测。每个触觉传感器由四层结构组成:顶部传感层、底部传感层、聚二甲基硅氧烷(PDMS)层和中间的多孔材料层。顶部和底部传感层具有相同的结构设计,包括沉积在柔性聚酰亚胺衬底上的两个同心铂(Pt)热敏电阻。其传感原理是基于热传导,传感层上的热膜既充当焦耳加热器,又充当自身的温度检测器,可灵敏地感知周围环境的热传导变化。

图2 多模态触觉传感器的结构、工作原理和功能

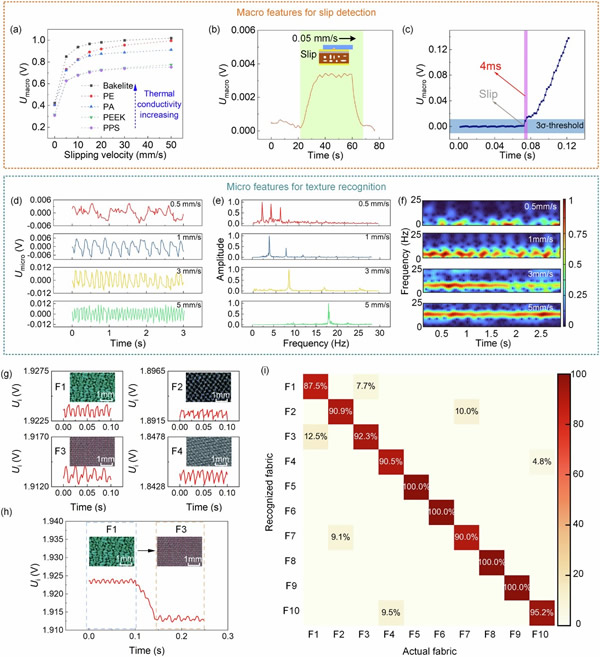

多模态触觉传感器顶部传感层响应信号中的宏观特征可用于表征传感器表面物体的滑动状态。研究团队选取不同材料进行了测试,并分别记录了传感器在各种滑动速度下的响应。实验结果表明,该触觉传感器在滑动检测方面表现优异,具有超高灵敏度(最低检测限达0.05 mm/s)和超快响应速度(4 ms),性能远超现有的其它滑动检测传感器。这种出色的滑动检测能力,能够确保机器人实现可靠抓取和稳定持握,避免物体掉落或危及安全。此外,利用其优异的导热性和纹理感知能力,该触觉传感器在织物识别任务中实现了高达94.3%的准确率。

图3 多模态触觉传感器用于滑移检测和纹理识别

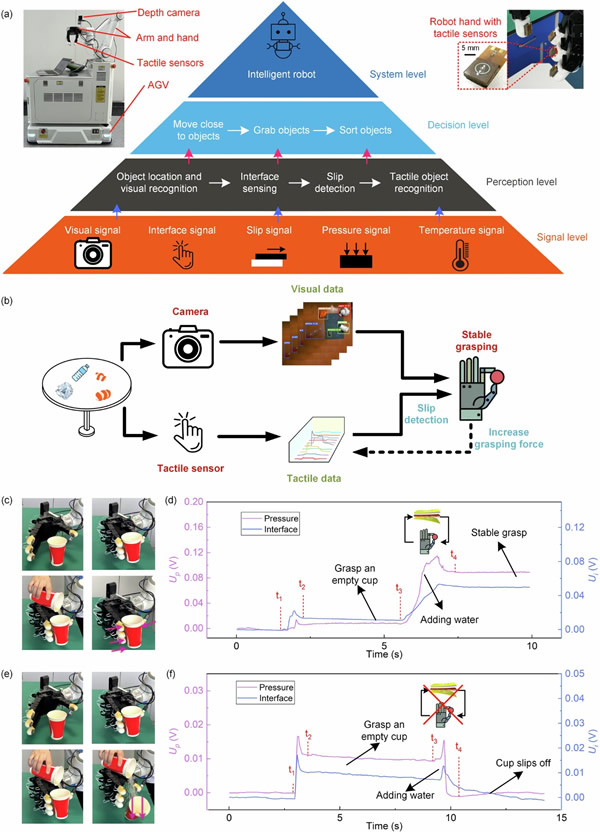

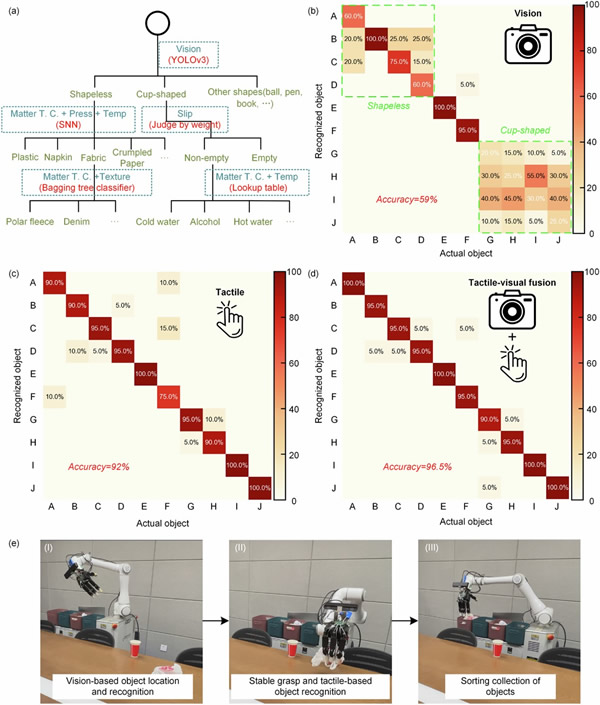

为了使机器人能够灵活应对家政服务中的各种复杂情况,需要整合机器人的触觉和视觉感知能力,使其能够有效协调感知认知、行为决策以及系统控制。鉴于此,研究团队进一步提出一种触觉-视觉融合架构,该架构从信号、感知和决策层面全方位整合了触觉和视觉信息,赋予了机器人强大的感知能力和执行能力。基于该架构,研究团队设计了一系列触觉-视觉融合策略,用于物体抓取和识别。抓取策略利用快速灵敏的滑移反馈,能以最小抓握力实现精准抓取。触觉-视觉融合识别策略则采用混合级联方法,能够准确识别各种生活必需品,包括识别杯中的液体含量。经实验验证,该触觉-视觉融合识别策略对日常生活中的常见物体的识别准确率高达96.5%,显著优于单纯使用视觉(59%)或触觉(92%)的识别方法。此外,利用触觉-视觉融合架构和相应的抓取/识别策略,机器人能够成功完成自主清洁桌面任务。这些成果充分证明了具备触觉-视觉融合感知的智能机器人在家政服务领域的广阔发展前景,未来有望减轻对人体力劳动的需求。

图4 机器人触觉-视觉融合感知架构

图5 用于物体分类和桌面清洁的触觉-视觉融合识别策略

这项研究开发的多模态触觉传感器和触觉-视觉融合架构,为机器人赋予了卓越的感知和执行能力,为人机之间更加灵活可靠的交互奠定了基础,有望极大地改变人类的日常生活。研究团队表示,未来计划探索更先进的算法,例如大型语言模型,以进一步拓展机器人的能力边界,为智能家居和服务机器人的发展开辟新的可能性。

论文信息:https://doi.org/10.1038/s41467-024-51261-5

延伸阅读:

上一篇:超薄柔性GMR电子皮肤,实现非接触式交互和压力传感

下一篇:最后一页